Não se afoguem mais em uma tonelada de Logs, ELK te salva! (Real-time)

Hoje em dia a análise de Big Data é cada vez mais importante por uma série de fatores, um deles é a tomada de decisão sobre o que fazer com determinado produto, serviço ou aplicação e, por conta disso, quem não faz análise de seus logs acaba ficando para trás. Isso é válido para empresas, Sysadmins, engenheiros, e principalmente a galera DevOps. Com base nesta questão, este artigo mostra uma das muitas formas de fazer isso, utilizando de tecnologias como: ELK, Docker e outras ferramentas essenciais para uma Infraestrutura Ágil, tudo isso em Real-time.

[ Hits: 18.423 ]

Por: Uriel Ricardo em 18/10/2016

Configurando o Filebeat.yml

filebeat.yml

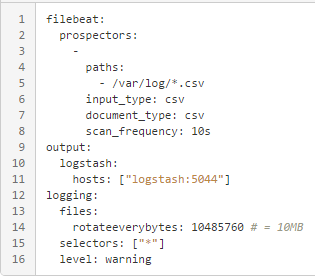

Dentro do diretório "./filebeat" do repositório, podemos encontrar o arquivo: "filebeat.yml", ele vai ter mais ou menos esta aparência:

Na linha 5, estamos dizendo que tudo que for .csv na no diretório "/var/log/" do container vai ser do tipo "csv" e irá fazer scan no file a cada 10 segundos.

Já na linha 11 é onde eu declaro por onde esses dados vão sair! Como eu havia dito antes é nesta parte que podemos decidir para onde enviar nossos dados, seja localmente ou remotamente... Onde diz: " hosts: ["logstash:5044"] ", Eu poderia ter configurado com o ip de um outro host, para a porta 5044 que vai ser por onde o Logstash vai "ouvir", no meu caso está "logstash" que é o nome da mascara de rede de um container!

Mais abaixo é configurado o Logging onde configuramos o rotacionamento dos logs, o level que por padrão é warning e os seletores que no meu caso é todos!

Com isso configurado já podemos passar para o Logstash, que é a parte mais legal de toda a stack ELK!

2. Entendendo e configurando o Elk

3. Configurando o Filebeat.yml

4. Configurando o Logstash.conf

5. Acessando Kibana e analisando meu dados (Real-time)

Publicidade e software LIVRE? De novo?

Instalando o AIGLX + Beryl atualizado no Debian Etch

Deixando o Gnome com a cara do Mac OS X

Parabéns pelo artigo, muito bem explicado! Achei você bem detalhista, lhe encontrei no LinkedIn, por acaso teria interesse em palestrar sobre isso na GDG DevFest em são Paulo?

E quanto ao artigo, teria este material em PDF?

Fantastico!

Especialista em Banco de Dados

[1] Comentário enviado por FelipeCoutinhoS em 19/10/2016 - 00:09h

Parabéns pelo artigo, muito bem explicado! Achei você bem detalhista, lhe encontrei no LinkedIn, por acaso teria interesse em palestrar sobre isso na GDG DevFest em são Paulo?

E quanto ao artigo, teria este material em PDF?

Olá Amigo, tudo bem? Lhe respondi na mensagem privada que me enviou, agradeço pelo feedback! Quanto ao pdf enviei para seu e-mail em anexo!

[2] Comentário enviado por cesar.dba em 20/10/2016 - 08:29h

Fantastico!

Especialista em Banco de Dados

Muito Obrigado pelo FeedBack =)

Assunto bem interessante. Obrigado pelo excelente artigo!

[5] Comentário enviado por eddye00 em 03/11/2016 - 09:22h

Assunto bem interessante. Obrigado pelo excelente artigo!

Eu que lhe agradeço, muito obrigador por ler meu artigo!

Amigo bom dia,

Poderia me enviar em pdf o artigo por e-mail?!

Especialista em Banco de Dados

Primeiramente você deve se preocupar em responder: o que é big data? Uma base grande? Grande quanto? Qual o maior gargalo em analisar big data? Como é feita a paralelização das análises?

Quando você conseguir responder estas perguntas, vai entender que não existe sentido em chamar logs gerados por um servidor de big data tal como não existe maneira de analisar uma base realmente grande em um único servidor. A maioria dos métodos de analise supõe que exista um driver (servidor ou pc aonde o código da análise é escrito) e vários workers (outros servidores que fazem a análise em paralelo). Métodos baseados no haboop tem um gargalo enorme (fora o problema da linguagem, só se pode usar Java), visto que existe muita leitura e escrita nos discos. Já frameworks mais novos, como o Apache Spark colocam toda a base a ser analisada em cache na memoria RAM, tornando as análizes até 100x mais rápidas que via hadoop. Além disto pode ser programado em Python, Scala, Java e R. Enfim, estou ilustrando este senário pois vejo muitos cursos de pós-graduação se propondo a abordar big data, porém o fazem de maneira totalmente equivocada, dando a impressão que qualquer base "grande" é big data.

Sei que seu propósito era apenas abordar alguns tools, porém gostaria de contribuir com estas reflexões.

Bom dia. Nobre amigo sigo todo o tutorial, mas não estou conseguindo encontrar esse comando docker-compose up -d. Poderia me ajudar? Fico no aguardo. Grato.

[9] Comentário enviado por iranmeneses em 05/05/2017 - 11:25h

Bom dia. Nobre amigo sigo todo o tutorial, mas não estou conseguindo encontrar esse comando docker-compose up -d. Poderia me ajudar? Fico no aguardo. Grato.

Tudo bem? você chegou a instalar o docker compose???

Patrocínio

Destaques

Artigos

Passkeys: A Evolução da Autenticação Digital

Instalação de distro Linux em computadores, netbooks, etc, em rede com o Clonezilla

Título: Descobrindo o IP externo da VPN no Linux

Armazenando a senha de sua carteira Bitcoin de forma segura no Linux

Enviar mensagem ao usuário trabalhando com as opções do php.ini

Dicas

Instalando Brave Browser no Linux Mint 22

vídeo pra quem quer saber como funciona Proteção de Memória:

Encontre seus arquivos facilmente com o Drill

Mouse Logitech MX Ergo Advanced Wireless Trackball no Linux

Compartilhamento de Rede com samba em modo Público/Anônimo de forma simples, rápido e fácil

Tópicos

VMs e Interfaces de Rede desapareceram (12)

Instalação do drive do adaptador wiffi (7)

Top 10 do mês

-

Xerxes

1° lugar - 74.481 pts -

Fábio Berbert de Paula

2° lugar - 54.574 pts -

Mauricio Ferrari

3° lugar - 16.980 pts -

Andre (pinduvoz)

4° lugar - 15.693 pts -

Alberto Federman Neto.

5° lugar - 15.483 pts -

Daniel Lara Souza

6° lugar - 15.119 pts -

Diego Mendes Rodrigues

7° lugar - 14.793 pts -

Buckminster

8° lugar - 13.604 pts -

edps

9° lugar - 12.501 pts -

Alessandro de Oliveira Faria (A.K.A. CABELO)

10° lugar - 11.813 pts