Tutorial Kettle

O Kettle é uma ferramenta para integração de dados, responsável pelo processo de Extração, Transformação e Carga (ETL). Ferramentas ETL são utilizadas mais frequentemente em projetos de data warehouse, mas também podem ser utilizadas para outros propósitos, tais como migração de dados entre aplicações, exportação de banco para arquivos, limpeza de dados e na integração de aplicações.

[ Hits: 69.648 ]

Por: Giovanni Won Dias B. Victorette em 08/01/2010

Utilizando variáveis e tratando strings

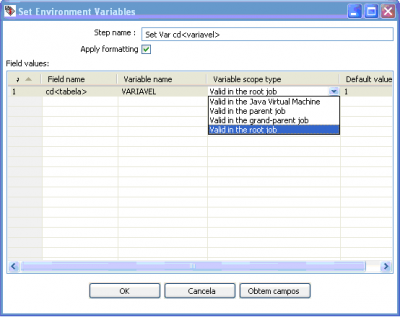

Na figura 7 pode-se notar que o valor para iniciar a contagem está definido por ${VARIAVEL}, esta é uma nomenclatura padrão. O que é importante saber aqui é que as variáveis definidas em uma transformação, só podem ser utilizadas em outras transformações e não nela mesma.

Sendo assim deve-se criar uma transformação para iniciar estas variáveis (figura 8).

Figura 8 - Transformação setVariables

Tratando string e colocando valores de uma coluna em uma linha

Por algumas vezes ou por alguma característica que queremos isolar, existe a necessidade de trabalhar com partes de uma string. No Kettle isso é possível ser feito com o uso da função "Strings cut" (figura 10). Basicamente ao editar este passo basta informar os campos que necessitam de edição e informar ponto de inicio e fim para o corte. Esta ação pode sobrescrever o campo ou, caso seja necessário, poderá ser escrito em um novo campo definido pelo usuário. Também na figura 10 podemos identificar um passo chamado "Row flattener". Que em linhas gerais, e até pelo próprio desenho, coloca n valores consecutivos de uma coluna em n colunas em uma mesma linha. De acordo com a figura 11, a coluna chSinalizacao vai ser transformada em 3 colunas na mesma linha.Assim para cada 3 linhas consecutivas na entrada a saída será uma única linha com 3 novas colunas, esta operação ocorre até que todas as linhas da entrada sejam percorridas. Vale lembrar que está é uma situação específica e depende da ordenação dos dados de entrada, caso contrário poderá produzir um registro com dados inconsistentes.

Figura 11 - Row flattener

2. Download e instalação

3. Montando uma transformação

4. Utilizando variáveis e tratando strings

5. Utilizando Java Script e Database Lookup

6. Extração a partir de XML e XLS, montando um Job e utilizando serviços de FTP/e-mail

Montando um roteador com o floppyFW

Instalando o Interbase 7.5 no Debian Sarge

Criando uma mala direta com OpenOffice.org

Utilizando arquivos Access (.mdb) no seu Linux

Olá,

Gostaria de parabenizá-lo pelo artigo. Parece ser uma ferramenta interessante, dado que para BI, conheço somente ferramentas pagas, não caras, mas pagas. Mas, como comentário, ficou faltando somente esclarecer um pouco mais, dado que é uma ferramenta de ETL, sobre as suas bases : Granularidade, Dimensões, Fatos... Bom, mas ficou muito bom.

Parabéns

Abraços

Obrigado pelo comentário,

Sobre data warehouse apenas comentei no texto, se tiver que escrever algo vai render outro artigo, mas já existe muito material publicado sobre o tema na internet. O foco aqui é mesmo a ferramenta e os primeiros passos com a mesma.

Abraços

Olá Giovanni,

Parabéns pelo trabalho apesar de não ter lido todo o artigo vejo que vc se esforçou para fazer um bom e apresentável artigo.

Segue meu site, www.ademargomes.com, onde você pode encontrar bastante material sobre Kettle e outras coisas.

Me senti a vontade de colocar aqui meu site pois escrevi um artigo de Kettle muito próximo do seu, mas esse foi pro site no ano passado, por tanto não tem plagio :)

Sorte e Sucesso,

AdeamrGomes

P.S. Link do artigo: http://www.ademargomes.com/index.php/artigos/56-turialkettle.html

Estou tentando criar alguns "mapas" com o Kettle e me deparei com uma barreira: como utilizar os dados de um Input "pai" para retornar valores de um Input "filho" ?

Explico: digamos que tenho que montar um arquivo de Pedidos no seguinte formato:

CAPA: NRO_PEDIDO | DATA_PEDIDO | VALOR

ITENS:NRO_PEDIDO | NRO_PRODUTO|QTD|PRECO

Exemplo:

101|2010-02-26|100,00

101|123|1,00|40,00

101|321|2,00|30,00

102|2010-02-26|20,00

102|456|2,00|10,00

Penso que para construir algo parecido eu utilizaria um Input com uma query buscando as capas de pedidos, e o fluxo (ou hop) seguiria para outro Input, desta vez buscando os itens. Este é o ponto: como fazer o segundo Input receber um valor do primeiro input?

Em resumo:

Input_nro_1: select nro_pedido, data_pedido, valor from PEDIDO;

Input_nro_2: select nro_produto, qtd, preco from ITEM_PEDIDO where nro_pedido = Input_nro_1.Nro_pedido

Deu pra entender?

valeu!

Henrique,

Vamos ver se entendi, existem formas de se fazer o que precisa:

1) As tabelas estão na mesma base? se estão pode montar a consulta em um único "input"

ficaria:

SELECT c.nro_pedido, c.data_pedido, c.valor

FROM CAPA c

INNER JOIN ITENS i

ON c.nro_pedido = i.nro_pedido

2) Se estão em bases distintas, utiliza-se o passo de JOIN que existe no kettle para realizar esta junção entre os dois inputs;

Valeu!

Opa, não tinha visto que tinha retornado ao meu comentário...

Bem, vamos lá... vc quase entendeu.

É o caso 1, estão na mesma base. Mas eu gostaria de tratar em inputs distintos, ou seja, capa em um input e item em outro input. Entretanto, o input2, ou seja, dos itens, iria ser aberto para cada capa.

Pq isto? Pq eu quero gravar a capa do pedido no destino e depois o item, mas eu preciso garantir a integridade dos dados, ou seja, eu tenho que gravar a capa antes de gravar o item, e para isto acredito que tenho que abrir o Input do item apenas após realizar o output da capa.

Um diagrama de exemplo seria assim:

|CAPA|--->---|OUTPUT|--->---|ITEM|--->---|OUTPUT|

Deu para entender?

Ou o correto neste caso seria um Transformation para Capa e outro Transformation para Item?

valeu!!

Giovanni, parabéns pela iniciativa. Estou dando meus primeiros passos rumo a BI. Participei de um treinamento em Brasília/DF com Caio Moreno (o professor coruja - http://blog.professorcoruja.com) e estou finalizando "Inteligência Competitiva" pela FGV.

Passou por um problemão por mais de 30 dias: conectar ao DB Progress via JDBC. Consegui, Ufa! Criei http://inpentaho.blogspot.com para deixar a solução registrada.

Não pare de postar sobre o KETTLE.

Jesus bless.

Patrocínio

Destaques

Artigos

Passkeys: A Evolução da Autenticação Digital

Instalação de distro Linux em computadores, netbooks, etc, em rede com o Clonezilla

Título: Descobrindo o IP externo da VPN no Linux

Armazenando a senha de sua carteira Bitcoin de forma segura no Linux

Enviar mensagem ao usuário trabalhando com as opções do php.ini

Dicas

Instalando Brave Browser no Linux Mint 22

vídeo pra quem quer saber como funciona Proteção de Memória:

Encontre seus arquivos facilmente com o Drill

Mouse Logitech MX Ergo Advanced Wireless Trackball no Linux

Compartilhamento de Rede com samba em modo Público/Anônimo de forma simples, rápido e fácil

Tópicos

VMs e Interfaces de Rede desapareceram (12)

Instalação do drive do adaptador wiffi (7)

Top 10 do mês

-

Xerxes

1° lugar - 74.481 pts -

Fábio Berbert de Paula

2° lugar - 54.574 pts -

Mauricio Ferrari

3° lugar - 16.980 pts -

Andre (pinduvoz)

4° lugar - 15.693 pts -

Alberto Federman Neto.

5° lugar - 15.483 pts -

Daniel Lara Souza

6° lugar - 15.119 pts -

Diego Mendes Rodrigues

7° lugar - 14.793 pts -

Buckminster

8° lugar - 13.604 pts -

edps

9° lugar - 12.501 pts -

Alessandro de Oliveira Faria (A.K.A. CABELO)

10° lugar - 11.813 pts